初创企业Algolux:自动化视觉发展的推动者

2018-01-13 10:48:25 来源:麦姆斯咨询 评论:0 点击:

微访谈:Algolux总裁兼首席执行官Allan Benchetrit

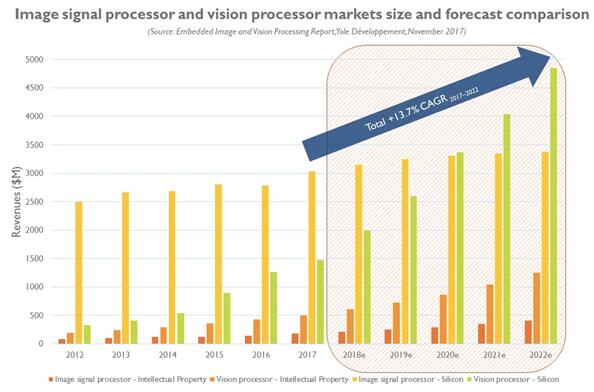

据麦姆斯咨询报道,在强大的AI(人工智能)算法诞生之前,图像信号处理器(ISP)中实现的图像处理功能相当简单,其将来自图像传感器的信号转换为人眼可以理解的图像。工程师们通常采用专用ISP的硬件架构呈流水线式地逐个处理像素。这种方式催生了能运行AI算法的更加强大的视觉处理硬件,具有存储整个图像的内存。根据Yole发布的《嵌入式图像和视觉处理-2017版》,汽车将是这项技术最重要的应用领域之一。

随着车辆朝着无人驾驶和传感器融合的方向发展,AI技术和相关的硬件正在相互作用,以在前沿领域发挥作用。Algolux是一个年轻而富有魅力的创业公司,对图像处理和AI的作用深有了解,并努力自主开发出有趣的方式将两者结合起来。因此,Yole专访了Algolux公司的总裁兼首席执行官Allan Benchetrit,对Algolux的情况和技术做了详细探讨。

2012~2021年视觉系统的硬件市场发展情况

YoleDéveloppement(以下简称YD):请您谈谈Algolux公司的情况和产品。

Allan Benchetrit(以下简称AB):Algolux通过机器学习实现了自动化视觉,使摄像头能够更清晰地看到并感知,这是当前视觉系统无法完成的。通过CRISP-ML这套工具,我们机器学习的工作流程可将典型的3~6个月才能完成图像质量处理工作缩短至几小时或几天。更进一步讲,我们认识到,在困难的成像场景中,视觉系统对鲁棒性的要求比现有方法更高。Algolux使用基于CANA DNN的完整感知堆栈解决了这个问题,并取代现有的基于ISP的架构。

Algolux总部位于加拿大的蒙特利尔,在帕洛阿尔托和慕尼黑设有办事处。主要专注于汽车市场,但我们的技术适用于任何基于摄像头的应用,如视频监控和智能手机。我们的产品不仅受到客户的充分认可,在挑战性问题的创新能力也受到行业的高度认可,最近我们获得了AutoSens颁发的“最精彩创业公司”(Most Exciting Startup)奖项。

YD:为什么Algolux一开始就专注在汽车应用市场?

AB:Algolux主要关注汽车中的成像和感知案例。高级驾驶辅助系统(ADAS)和无人驾驶面对的挑战性场景——在暗光、强光、噪音、高动态范围、恶劣天气和镜头等,至今未得到有效解决的问题。另一个驱动因素是汽车行业在IEEE P2020中的合作,以建立计算机视觉图像质量标准,我们也参与其中。当行业领导者意识到目前的方法不会一贯地实现这些系统的关键任务安全目标时,工作组就形成了,这是Algolux可以帮助优化结果的自然区域。

YD:在标准相机里,相比ISP流水线式的处理方式,创建物体探测的神经网络是否会更加复杂?

AB:两者实际上都相当复杂,但也有一些关键的区别。ISP由多个连续的阶段组成,对传感器捕获的图像的颜色、清晰度、噪声等进行处理。每个阶段的算法都是根据任务精心设计的,虽然事实上前面的任务只是用作参考。然后由“成像专家”通过数千个参数对ISP进行“调整”,从而从特定的镜头和传感器组合中获得最佳的图像。最终得到的是视觉上令人满意的图像,但调整时间可能几个月。

基于AI的感知任务,如物体识别,通常在由许多层组成的深度神经网络(DNN)中实现,每层都有许多节点进行计算,类似于大脑中的神经元。DNN通过特定任务的注释图像的大量数据进行训练,允许DNN学习如何识别行人、汽车和卡车。

在如今的架构中,来自ISP的图像会传送到DNN。关键的限制是ISP是基于专业的视觉设计和调整产生令人满意的图像,但不太适合计算机算法(DNN)来识别对象。

YD:在ADAS和无人驾驶领域,Algolux打算用CANA感知堆栈替换流水线式信号处理。你认为还可以推广到无人驾驶以外的应用吗?

AB:由于ISP是以人类视觉而不是计算机视觉为目标,我们的首席技术官兼技术发明人Felix Heide看到取代这个限制因素的机会,我们用完整的DNN堆栈来“学习”是处理来自传感器的图像与感知任务的最好方式。在汽车任务方面,与目前使用具有DNN感知的现有ISP的方法相比,结果准确度显着提高。对于典型的分类任务,我们也看到了相同的改进,所以这种方法的推广前景不错。

YD:在您看来,随着AI技术的出现,硬件和软件公司开发视觉系统面临的风险是什么?

AB:AI,特别是深度学习,以惊人的速度提高了机器感知周围环境的能力。半导体行业在图形处理单元(GPU)和神经处理单元(NPU)部署方面也有了明显的变化,在神经网络以较低的功率运行以实现更复杂的任务得以加速。同样,在AI软件创新和基础设施方面也有巨大的投资。我们目前还处于初期阶段,但谁将会成为领导者,这是一场高风险的竞赛。

YD:Yole预计,汽车成像和传感市场将从简单的ISP转变集成有AI处理器的融合处理器板开始。支持这种转变的关键硬件和软件参数是什么?

AB:这些新方法需要大量的嵌入式处理,无论是计算机视觉电子控制单元还是智能边缘摄像头,对降低功耗的同时提高处理性能的需求至关重要。智能传感器融合在提取和处理单独的数据密集型信息流时会增加处理负荷。从客户那里,我们听到很多业内人士就基于所处理的任务探索不同的融合方法和模型而进行的讨论。但是,我们强烈主张具有互补性的传感器和融合才是无人驾驶车辆的未来趋势。

延伸阅读:

上一篇:MEMS扬声器首次亮相CES 2018,USound谈音频行业未来

下一篇:MEMS需求旺盛,STATS ChipPAC未雨绸缪下一代封装技术